Vor Zurück Inhalt

9. Der Philosoph aus Birmingham

Aaron Sloman, Professor für Philosophie an der School of Computer Science der Universität Birmingham, zählt mit Sicherheit zu den einflußreichsten Theoretikern im Hinblick auf Computermodelle von Emotionen. Bereits im Jahr 1981 verkündete er im Titel eines Aufsatzes: "Why robots will have emotions". Seine Begründung lautete:

Wie Bates, Reilly oder Elliott vertritt auch Sloman den broad and shallow-Ansatz. Für ihn ist es wichtiger, ein komplettes System mit wenig Tiefe zu entwickeln als einzelne Module mit viel Tiefe. Nur so kann, seiner Meinung nach, ein Modell entstehen, das einigermaßen realistisch die Wirklichkeit widerspiegelt.

Sloman und seine Mitarbeiter im Cognition and Affect Project haben seit 1981 eine Vielzahl von Arbeiten zum Thema "intelligente Systeme mit Emotionen" veröffentlicht, die sich grob in drei Kategorien unterteilen lassen:

- Arbeiten, die sich mit der grundlegenen Herangehensweise an die Konstruktion eines intelligenten Systems befassen;

- Arbeiten, die sich mit den grundlegenden Elementen eines solchen Systems befassen und

- Arbeiten, die versuchen, ein solches System praktisch zu implementieren.

Um Slomans Ausführungen richtig einordnen zu können, muß man sie in den Kontext seines (erkenntnis-)theoretischen Ansatzes stellen, der sich nicht in erster Linie um Emotionen, sondern um die Konstruktion intelligenter Systeme dreht.

Im Folgenden soll versucht werden, die Kerngedanken von Slomans Theorie kurz darzustellen, da sie die Grundlage für das Verständnis des "libidinösen Computers" von Ian Wright (s.u.) bilden.

9.1. Ansätze zur Konstruktion intelligenter Systeme

Slomans Interesse bei seinen Arbeiten liegt nicht in erster Linie in einer Simulation des menschlichen Geistes, sondern in der Entwicklung eines generellen "intelligenten Systems", unabhängig von seiner körperlichen Substanz. Menschen, Bonobos, Computer und Außerirdische sind unterschiedliche Implementationen solcher intelligenten Systeme - die zugrundeliegenden Konstruktionsprinzipien sind jedoch identisch.

Sloman teilt die bisherigen Versuche, eine Theorie über die Funktionsweisen des menschlichen Geistes (und damit intelligenter Systeme allgemein) zu entwickeln, in drei große Gruppen ein: Semantikbasierend (semantics-based), phänomenbasierend (phenomena-based) und designbasierend (design-based).

Semantikbasierende Ansätze analysieren, wie Menschen psychische Zustände und Prozesse beschreiben, um implizite Bedeutungen zu ermitteln, die der Verwendung von Wörtern der Alltagssprache zugrundeliegen. Zu ihnen zählt er unter anderem die Ansätze von Ortony, Clore und Collins sowie von Johnson-Laird und Oatley. Slomans Argument gegen diese Ansätze lautet: "As a source of information about mental processes such enquiries restrict us to current `common sense´ with all its errors and limitations." (Sloman, 1993, S. 3)

Auch manche Philosophen, die Konzepte analytisch untersuchen, produzieren, laut Sloman, semantikbasierende Theorien. Was sie von den Psychologen jedoch unterscheidet, ist die Tatsache, daß sie sich nicht allein auf existierende Konzepte konzentrieren, sondern oft mehr interessiert sind an der Menge aller möglichen Konzepte.

Phänomenbasierende Ansätze gehen davon aus, daß psychische Phänomene wie "Emotion", "Motivation" oder "Bewußtsein" bereits klar sind und daß jeder konkrete Beispiele dafür intuitiv erkennen kann. Sie versuchen deshalb nur noch, gleichzeitig auftretende und meßbare Phänomene (z.B. physiologische Effekte, Verhalten, Umwelteigenschaften) mit dem Auftreten solcher psychischer Phänomene zu korrelieren. Diese Ansätze, so Sloman, sind besonders bei Psychologen zu finden. Seine Kritik an solchen Ansätzen lautet:

Designbasierende Ansätze durchbrechen die Grenzen dieser beiden Ansätze. Sloman bezieht sich hier ausdrücklich auf die Arbeiten des Philosophen Daniel Dennett, der wie kaum ein anderer die Debatte um intelligente Systeme und Bewußtsein geprägt hat.

Dennett unterscheidet zwischen drei Heransgehensweisen, wenn man Vorhersagen über eine Entität treffen will: physical stance, design stance und intentional stance. Der physical stance ist "simply the standard laborious method of the physical sciences" (Dennett, 1996, S. 28); der design stance dagegen nimmt an, "that an entity is designed as I suppose it to be, and that it will operate according to that design" (Dennett, 1996, S. 29). Der intentional stance schließlich, der nach Dennett auch als "Subspezies" des design stance betrachtet werden kann, sagt das Verhalten einer Entität, zum Beispiel eines Computerprogramms, so voraus "as if it were a rational agent" (Dennett, 1996, S. 31).

Vertreter des designbasierenden Ansatzes gehen von der Position eines Ingenieurs aus, der versucht, ein System zu konstruieren, das die zu erklärenden Phänomene produziert. Allerdings erfordert nicht jedes Design zugleich auch einen Designer:

Ein Design ist, streng genommen, nichts anderes als eine Abstraktion, die eine Klasse möglicher Instanzen bestimmt. Es muß auch nicht notwendigerweise konkret oder materiell implementiert sein - obwohl seine Instanzen durchaus eine körperliche Form haben können.

Für Sloman ist der Begriff des Designs eng verknüpft mit dem Begriff der Nische. Auch eine Nische ist keine materielle Entität und keine geographische Region. Sloman definiert sie in einem breiten Sinn als eine Sammlung von Anforderungen an ein funktionierendes System.

Im Hinblick auf die Entwicklung intelligenter Agenten in der AI spielen Design und Nische eine besondere Rolle. Sloman spricht von design-space und niche-space. Ein lebensechtes intelligentes System wird mit seiner Umwelt interagieren und sich im Laufe seiner Evolution verändern. Damit bewegt es sich auf einer bestimmten Bahn (trajectory) durch den design-space. Damit korrespondiert auch eine bestimmte Bahn durch den niche-space, denn durch die Veränderungen des Systems kann es neue Nischen besetzen:

Sloman identifiziert unterschiedliche Bahnen durch den design-space: Individuen, die sich adaptieren bzw. sich verändern können, durchlaufen sogenannte i-trajectories. Evolutionäre Entwicklungen, die nur über Generationen von Individuen hin möglich sind, bezeichnet er als e-trajectories. Und schließlich gibt es Veränderungen an Individuen, die von außen vorgenommen werden (zum Beispiel das Debuggen von Software) und die er als r-trajectories (r für Reparatur) bezeichnet.

Zusammengenommen ergeben diese Elemente dynamische Systeme, die auf unterschiedliche Weise implementiert werden können.

Für Sloman besteht eine der vordringlichsten Aufgaben darin, biologische Termini wie Nische, Genotyp usw. zu präzisieren, um die Beziehungen zwischen Nischen und Designs für Organismen genau verstehen zu können. Das sei auch ein wesentlicher Fortschritt für die Psychologie:

Sloman räumt ein, daß die Anforderungen an designbasierende Ansätze nicht trivial sind. Er nennt fünf Anforderungen, die ein solcher Ansatz erfüllen sollte:

- Analyse der Anforderungen an einen autonomen intelligenten Agenten;

- eine Design-Spezifikation für ein funktionierendes System, welche die Anforderungen von (1) erfüllt;

- eine detaillierte Implementation oder eine Spezifikation für eine solche Implementation eines funktionierenden Systems;

- eine theoretische Analyse, inwieweit die Design-Spezifikation und die Details der Implementation die Anforderungen erfüllen oder nicht erfüllen sowie

- eine Analyse der Nachbarschaft im design-space.

Ein designbasierender Ansatz muß dabei nicht zwangsläufig ein Top-Down-Ansatz sein. Sloman verspricht sich den meisten Erfolg von Modellen, die top-down und bottom-up kombinieren.

Für Sloman sind designbasierende Theorien effektiver als andere, denn:

9.2. Die grundlegende Architektur eines intelligenten Systems

Das, was ein designbasierender Ansatz entwirft, sind Architekturen. Eine solche Architektur erklärt, welche Zustände und Prozesse für ein System möglich sind, das diese Architektur besitzt.

Aus der Menge aller möglichen Architekturen ist Sloman an einer bestimmten Klasse besonders interessiert: "..."high level" architectures which can provide a systematic non-behavioural conceptual framework for mentality (including emotional states)." (Sloman, 1998a, S. 1) Ein solches framework for mentality

Eine Architektur für ein intelligentes System besteht nach Sloman aus vier wesentlichen Bestandteilen: mehreren funktional unterschiedlichen Verarbeitungsschichten, Kontrollzuständen, Motivatoren und Filtern sowie einem globalen Alarmsystem.

9.2.1. Die Verarbeitungsschichten

Sloman geht davon aus, daß jedes intelligente System über drei Verarbeitungsschichten (layers) verfügt:

| eine reaktive Schicht, die automatische und fest verdrahtete Prozesse beinhaltet; | |

| eine deliberative Schicht zum Planen, Evaluieren, Ressourcen zuteilen usw.; | |

| eine Meta-Management-Schicht, die Beobachtungs- und Evaluationsmechanismen für interne Zustände beinhaltet. |

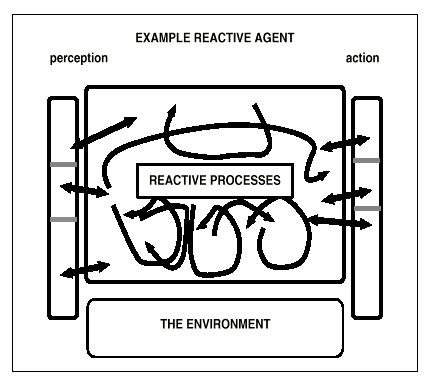

Die reaktive Schicht ist die evolutionsgeschichtlich älteste, und es gibt eine Vielzahl von Organismen, die lediglich über diese Schicht verfügen. Schematisch stellt sich ein rein reaktiver Agent so dar:

Abb. 13: Reaktive Architektur (Sloman, 1997a, S. 5)

Ein reaktiver Agent kann weder Pläne machen noch neue Strukturen entwickeln. Er ist optimiert für ganz spezielle Aufgaben; mit neuen Aufgaben dagegen kommt er nicht zurecht. Was ihm an Flexibilität fehlt, gewinnt er allerdings an Geschwindigkeit. Da nahezu alle Prozesse klar definiert sind, ist seine Reaktionsgeschwindigkeit hoch. Insekten sind, so Sloman, ein Beispiel für solche rein reaktiven Systeme, die zugleich beweisen, daß die Interaktion zahlreicher solcher Agenten verblüffend komplexe Ergebnisse hervorbringen kann (z.B. Termiten-Türme).

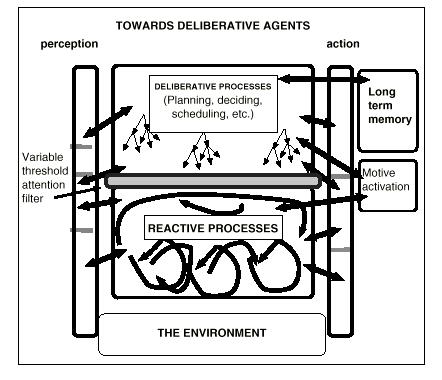

Eine zweite, phylogenetisch jüngere Schicht verleiht einem Agenten weitaus mehr Qualitäten. Schematisch sieht dies so aus:

Abb. 14: Deliberative Architektur (Sloman, 1997a, S. 6)

Ein deliberativer Agent kann sein Handlungsrepertoire beliebig neu kombinieren, Pläne entwickeln und vor der Ausführung evaluieren. Eine wesentliche Voraussetzung dafür ist ein Langzeitgedächtnis, um noch nicht komplettierte Pläne zu speichern bzw. die wahrscheinlichen Konsequenzen von Plänen abzulegen und später zu evaluieren.

Die Konstruktion solcher Pläne geht schrittweise voran und ist deshalb kein kontinuierlicher, sondern ein diskreter Prozess. Viele der Prozesse in der deliberativen Schicht sind serieller Natur und damit ressourcenlimitiert. Diese Serialität bietet eine Reihe von Vorteilen: dem System ist jederzeit klar, welcher Plan zu einem Erfolg geführt hat und es kann entsprechend Belohnungen zuteilen; die Ausführung sich widersprechender Pläne gleichzeitig wird verhindert; die Kommunikation mit dem Langzeitspeicher verläuft weitgehend fehlerfrei.

Ein solches ressourcenlimitiertes Subsystem ist natürlich hoch störanfällig. Deshalb sind Filterungsprozesse mit variabler Schwelle notwendig, um das Arbeiten des Systems sicherzustellen (s.u.).

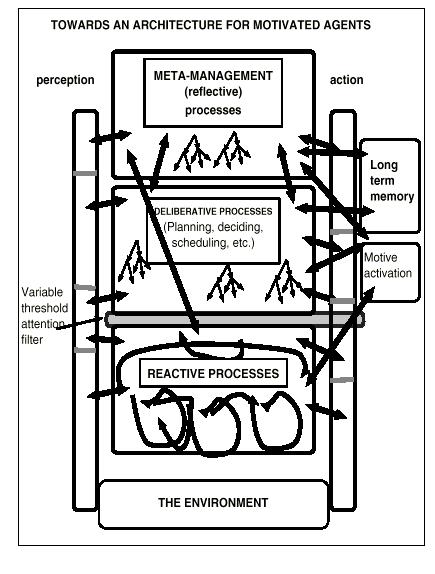

Die phylogenetisch jüngste Schicht des Gesamtsystems ist das von Sloman so genannte Meta-Management:

Abb. 15: Meta-Management Architektur (Sloman, 1997a, S. 7)

Hierbei handelt es sich um einen Mechanismus, welcher die internen Vorgänge des Systems verfolgt und evaluiert. Ein solches Subsystem ist notwendig, um die in der deliberativen Schicht entwickelten Pläne und Strategien zu evaluieren und gegebenenfalls zu verwerfen, wiederkehrende Muster im deliberativen Subsystem zu erkennen, langfristige Strategien zu entwickeln und effektiv mit anderen zu kommunizieren.

Sloman weist darauf hin, daß diese drei Schichten nicht hierarchisch aufgebaut sind, sondern parallel und daß sie auch parallel arbeiten. Wie das Gesamtsystem, verfügen auch diese Module wiederum über eine eigene Architektur, die weitere Subsysteme mit eigener Architektur einschließen kann.

Das Meta-Management-Modul ist dabei in seiner Arbeit alles andere als perfekt. Das liegt daran, daß es keinen umfassenden Zugriff auf alle internen Zustände und Prozesse hat, daß die Kontrolle über das deliberative Subsystem unvollständig ist und daß die Selbst-Evaluationen auf falschen Voraussetzungen beruhen können.

9.2.2. Die Kontrollzustände

Eine Architektur wie die bislang skizzierte verfügt über eine Vielfalt von Kontrollzuständen (control states) auf unterschiedlichen Ebenen. Manche davon operieren auf höchstem Abstraktionsniveau, während andere unbewußt bei häufigen Kontrollentscheidungen ablaufen.

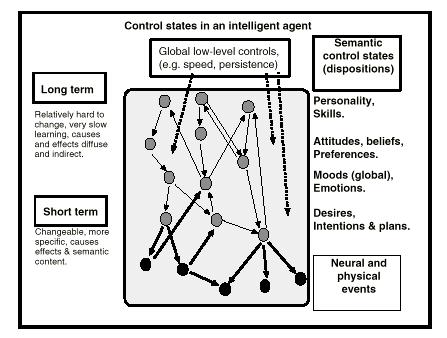

Die folgende Abbildung gibt einen Überblick über die Kontrollzustände des Systems:

Abb. 16: Kontrollzustände eines intelligenten Systems (Sloman, 1998b, S. 17)

Unterschiedliche Kontrollzustände besitzen auch unterschiedliche zugrundeliegende Mechanismen. So können manche chemischer Natur sein, während andere mit Informationsstrukturen zu tun haben.

Kontrollzustände enthalten Dispositionen, auf interne oder externe Reize mit internen oder externen Handlungen zu reagieren. Im Rahmen des Gesamtsystems können zahlreiche Kontrollzustände gleichzeitig existieren und miteinander interagieren.

Kontrollzustände sind in der Folk Psychology unter zahlreichen Namen bekannt: Wünsche, Präferenzen, Überzeugungen, Absichten, Stimmungen usw. Durch die Definition solcher Zustände über eine Architektur will Sloman eine "rationale Rekonstruktion vieler alltäglicher mentalen Konzepte" liefern.

Jeder Kontrollzustand verfügt unter anderem über eine Struktur, über Transformationsmöglichkeiten und gegebenenfalls auch über eine Semantik. Sloman illustriert dies am Beispiel eines Motivators (s.u.):

Kontrollzustände unterscheiden sich zudem auch darin, ob sie leicht oder nur sehr schwer zu verändern sind. Viele Kontrollzustände der höheren Ordnung, so Sloman, lassen sich nur in kleinen Schritten und in einem längeren Zeitraum modifizieren. Kontrollzustände höherer Ordnung sind zudem mächtiger und einflußreicher im Hinblick auf das Gesamtsystem als Kontrollzustände niedrigerer Ordnung.

Sloman postuliert einen Prozeß namens circulation, durch den die Kontrollzustände durch das Gesamtsystem zirkulieren. Nützliche Kontrollzustände können dabei in der Hierarchie nach oben steigen und ihren Einfluß vergrößern; unnütze Kontrollzustände können fast ganz aus dem System verschwinden.

Das Resultat all dieser Prozesse besteht in einer Art Diffusion, mit der die Effekte eines starken Motivators sich langsam in zahllose und langlebige control sub-states verteilen, bis hin zur irreversiblen Integration in Reflexe und automatische Reaktionen.

9.2.3. Motivatoren und Filter

Ein zentraler Bestandteil eines jeden intelligenten Systems sind Motivatoren. Sloman definiert sie als "mechanisms and representations that tend to produce or modify or select between actions, in the light of beliefs." (Sloman, 1987, S. 4).

Motivatoren können nur dann entstehen, wenn Ziele vorhanden sind. Ein Ziel ist eine symbolische Struktur (nicht notwendigerweise physischer Natur), die einen Zustand beschreibt, der erreicht, erhalten oder verhindert werden soll. Während Überzeugungen (beliefs) dadurch definiert sind, daß es sich hier um Repräsentationen handelt, die durch Wahrnehmungs- und Deliberationsprozesse sich an die Realität anpassen, sind Ziele Repräsentationen, die ein Verhalten auslösen, um die Realität an die Repräsentation anzupassen.

Motivatoren werden von einem Mechanismus generiert, den Sloman motivator generator oder motivator generactivator nennt. Motivatoren werden generiert aufgrund von externen oder internen Informationen oder von anderen Motivatoren produziert. Sloman definiert eine Motivator-Struktur formal über zehn Felder: (1) einen möglichen Zustand, der wahr oder falsch sein kann; (2) eine motivationale Einstellung diesem Zustand gegenüber; (3) eine Annahme (belief) über diesen Zustand; (4) einen Bedeutungswert (importance value); (5) eine Dringlichkeit (urgency); (6) einen Insistenzwert (insistence value); (7) einen oder mehrere Pläne; (8) einen commitment status; (9) Management-Informationen und (10) einen dynamischen Zustand wie z.B. "Plan aufgeschoben" oder "wird derzeit überlegt".

In einer späteren Arbeit (Sloman, 1997c) hat Sloman diese Struktur um zwei weitere Felder erweitert: (11) eine Begründung (rationale), sofern der Motivator aus einem expliziten Denkprozeß entstanden ist sowie (12) eine Intensität, die festlegt, ob ein bereits bearbeiteter Motivator auch weiterhin den Vorzug erhält vor anderen Motivatoren.

Die Stärke eines Motivators wird durch vier Variablen bestimmt:

- Die Insistenz (insistence) legt fest, mit welcher Wahrscheinlichkeit der Motivator den Filter (s.u.) überwinden kann;

- die Wichtigkeit (importance) bestimmt, mit welcher Wahrscheinlichkeit der Motivator anschließend akzeptiert und verfolgt wird;

- die Intensität (intensity) legt fest, wie aktiv und intensiv ein Motivator verfolgt wird, wenn er akzeptiert ist;

- die Dringlichkeit (urgency) bestimmt, bis zu welchem Zeitpunkt der Motivator verfolgt worden sein muß.

Motivatoren wetteifern miteinander um Aufmerksamkeit, also um die begrenzten Ressourcen des deliberativen Subsystems. Damit dieses Subsystem funktionieren kann, muß es einen Mechanismus geben, der verhindert, daß neue Motivatoren jederzeit die Aufmerksamkeit auf sich ziehen können. Zu diesem Zweck verfügt das System über einen sogenannten variable threshold attention filter.

Der Filter legt einen Schwellenwert fest, den ein Motivator überwinden muß, um Aufmerksamkeitsressourcen für sich beanspruchen zu können. Dieser Filter ist dabei, wie der Name bereits impliziert, variabel und kann sich, zum Beispiel durch Lernen, ändern. Sloman erläutert dies am Beispiel eines Fahranfängers, der sich während der Fahrt noch nicht mit jemand anderem unterhalten kann, weil er sich zu sehr auf die Straße konzentrieren muß. Nach einer gewissen Praxis ist ihm dies aber möglich.

Die Insistenz eines Motivators, also die entscheidende Variable für das Überwinden des Filters, ist ein schnell berechneter heuristischer Wert der Wichtigkeit und Dringlichkeit des Motivators.

Wenn ein Motivator aufgetaucht (surfaced) ist, also den Filter überwunden hat, werden mehrere Management-Prozesse aktiv. Ein solches Management ist nötig, weil stets mehrere Motivatoren durch den Filterprozeß gelangen. Diese Prozesse sind adoption-assessment (die Entscheidung, ob ein Motivator akzeptiert oder abgewiesen wird); scheduling (die Entscheidung, wann ein Plan für diesen Motivator ausgeführt werden soll); expansion (das Entwickeln von Plänen für den Motivator) sowie meta-management (die Entscheidung, ob und wann ein Motivator überhaupt vom Management berücksichtigt werden soll).

Slomans attention filter penetration theory erfordert einen höheren Grad an Komplexität als die Theorie von Oatley und Johnson-Laird. Er postuliert, daß nicht jeder Motivator die gerade laufende Aktivität unterbricht, sondern nur solche, die entweder einen hohen Grad an insistence aufweisen bzw. für die entsprechende attention filters nicht besonders hoch angesetzt sind.

9.2.4. Das globale Alarmsystem

Ein System, das in einer Umwelt überleben muß, die sich ständig verändert, benötigt einen Mechanismus, mit dessen Hilfe es ohne große Zeitverzögerung auf solche Veränderungen reagieren kann. Solch ein Mechanismus ist ein Alarmsystem.

Ein Alarmsystem ist nicht nur von Bedeutung für eine reaktive, sondern ebenso für eine deliberative Architektur. So kann beispielsweise das Vorausplanen eine Gefahr oder eine Chance deutlich machen, auf die umgehend mit einem Wechsel der Strategie geantwortet werden muß.

Sloman zieht eine Parallele zwischen seinem Alarmsystem und neurophysiologischen Befunden:

Die unterschiedlichen Schichten des Systems werden vom Alarmsystem beeinflußt, allerdings auf unterschiedliche Art. Zugleich können sie auch selber wiederum Informationen an das Alarmsystem übergeben und damit einen globalen Alarm auslösen.

9.3. Emotionen

Emotionen sind für Sloman keine eigenständigen Prozesse, sondern entstehen als emergentes Phänomen aus dem Zusammenspiel der unterschiedlichen Subsysteme eines intelligenten Systems. Deshalb besteht keine Notwendigkeit für ein eigenständiges "Emotions-Modul".

Eine Betrachtung psychologischer Emotionstheorien führt Sloman zu dem Schluß:

Wenn man hingegen Emotionen als Resultat einer entsprechend angelegten Architektur betrachtet, so können, laut Sloman, viele Mißverständnisse ausgeräumt werden. Eine Theorie, die Emotionen im Zusammenhang mit Architektur-Konzepten analysiert, ist für ihn daher effektiver als andere Ansätze:

Die unterschiedlichen Schichten der skizzierten Architektur unterstützen auch unterschiedliche Emotionen. Die reaktive Schicht ist verantwortlich für Ekel, sexuelle Erregung, Aufschrecken (startle) und Erschrecken vor großen, sich schnell nähernden Objekten. Die deliberative Schicht ist verantwortlich für Frustration durch Versagen, Erleichterung durch Gefahrenvermeidung, Angst vor Fehlschlägen oder angenehmes Überrraschtsein durch Erfolg. Die Meta-Management-Schicht unterstützt Scham, Erniedrigung, Aspekte von Trauer, Stolz, Ärger.

Dabei läßt Slomans Ansatz körperliche Begleiterscheinungen von Emotionen bewußt außer Acht. Für ihn handelt es sich dabei nur um periphere Phänomene:

Sloman will auch den Einwand nicht gelten lassen, daß Emotionen untrennbar mit körperlichem Ausdruck verbunden sind. Er kontert er mit dem Argument, es handele sich hierbei um "relics of our evolutionary history", die keine prinzipielle Bedeutung für die Emotionen hätten. Eine Emotion beziehe ihre Bedeutung nicht aus den körperlichen Gefühlen, die sie begleiten, sondern aus ihrem kognitiven Gehalt:

Ähnlich argumentiert er in Bezug auf eine Reihe nicht-kognitiver Faktoren, die bei menschlichen Emotionen eine Rolle spielen können, zum Beispiel chemische oder hormonelle Prozesse. Er stellt die Frage, ob die durch solche nicht-kognitiven Mechanismen ausgelösten affektiven Zustände wirklich so verschieden sind von denen, die durch kognitive Prozesse produziert werden:

Wie entstehen nun die Emotionen in Slomans intelligentem System? Grundsätzlich unterscheidet er zwischen drei Klassen von Emotionen, die den drei Schichten seines Systems entsprechen. Dabei können Emotionen einerseits durch interne Prozesse innerhalb jeweils einer dieser Schichten entstehen; andererseits durch Interaktionen zwischen den Schichten.

Emotionen werden häufig von einem Zustand begleitet, den Sloman "Perturbanz" (perturbance) nennt. Eine Perturbanz ist dann gegeben, wenn das Gesamtsystem teilweise außer Kontrolle geraten ist. Sie tritt immer dann auf, wenn ein zurückgewiesener, vertagter oder einfach unerwünschter Motivator wiederholt auftaucht und damit das Management anderer, wichtigerer Ziele verhindert oder erschwert.

Entscheidend ist dafür der Insistenzwert eines Motivators, der für Sloman einen dispositionalen Zustand darstellt. Als solcher kann ein hochinsistenter Motivator auch dann Perturbanzen auslösen, wenn er den Filter noch nicht überwunden hat bzw. noch nicht aktiv bearbeitet wird.

Perturbanzen können occurrent (Versuch, die Kontrolle über die Aufmerksamkeit zu erlangen) oder dispositional (kein Versuch, die Kontrolle über die Aufmerksamkeit zu erlangen) sein.

Perturbante Zustände unterscheiden sich nach mehreren Dimensionen: Dauer, interne oder externe Quelle, semantischer Inhalt, Art der Störung, Effekt auf Aufmerksamkeitsprozesse, Häufigkeit der Störung, positive oder negative Evaluation, Entwicklung des Zustandes, Abklingen des Zustandes usw.

Perturbanzen sind, wie Emotionen, emergente Effekte von Mechanismen, deren Aufgabe es ist, etwas anderes zu tun. Sie entstehen durch die Interaktion von

| ressourcenbegrenzter, aufmerksamer Verarbeitung; | |

| einem Subsystem, das neue Kandidaten für eine solche Verarbeitung produziert; | |

| einem heuristischen Filtermechanismus. |

Für das Auftauchen von Perturbanzen bedarf es also im System keines eigenen "Perturbanz-Mechanismus"; auch die Frage nach der Funktion eines perturbanten Zustandes ist aus diesem Blickwinkel nicht sinnvoll. Perturbanzen sind allerdings nicht mit Emotionen gleichzusetzen; sie sind vielmehr typische Begleiterscheinungen von Zuständen, die gemeinhin als emotional bezeichnet werden.

Für Sloman sind emotionale Zustände prinzipiell nichts anderes als motivationale Zustände, hervorgerufen durch Motivatoren.

Ein weiteres Kennzeichen der emotionalen Zustände besteht darin, daß sie neue Motivatoren produzieren. Wenn zum Beispiel ein erster emotionaler Zustand durch einen Konflikt zwischen einer Überzeugung und einem Motivator entstanden ist, können daraus neue Motivatoren entstehen, die zu neuen Konflikten innerhalb des Systems führen.

9.4. Die Implementation der Theorie in MINDER1

Sloman hat mit seiner Arbeitsgruppe ein arbeitsfähiges Computermodell namens MINDER1 entwickelt, in dem seine Architektur teilweise implementiert ist. Bei MINDER1 handelt es sich um eine reine Softwareimplementation; es gibt also keine Krabbelstube mit tatsächlichen Robotern. Das System wird im Folgenden überblickshaft beschrieben; eine detaillierte Darstellung findet sich in [Wright und Sloman, 1996].

MINDER1 besteht aus einer Art virtueller Krabbelstube, in der ein virtuelles Kindermädchen (der Minder) auf eine Reihe von virtuellen Babys aufpassen muß. Diese Babys sind "reaktive Minibots", die ständig in der Krabbelstube herumwandern und unterschiedlichen Gefahren ausgesetzt sind: sie können in Gräben fallen und beschädigt werden oder sterben; ihre Batterien können leerlaufen, so daß sie zu einer Aufladestation müssen; wenn die Batterien zu sehr geleert sind, sterben sie ebenfalls; Übervölkerung der Krabbelstube läßt manche Babys zu Rüpeln werden, die dann anderen Babys Schaden zufügen; beschädigte Babys müssen zur Reparatur in die Krankenstation gebracht werden; falls der Schaden zu groß ist, stirbt das Baby.

Der Minder hat nun unterschiedliche Aufgaben: Er muß dafür sorgen, daß die Babys keine Energie verlieren, daß sie nicht in einen Graben fallen oder anderen Gefahren ausgesetzt sind. Zu diesem Zweck kann er zum Beispiel Zäune bauen, um die Babys darin einzuschließen. Er muß Minibots, deren Energie auszugehen droht, zu einem Aufladepunkt bringen oder andere so weit wie möglich weg von einem Graben.

Diese Vielfalt der Aufgaben sorgt dafür, daß der Minder ständig neue Motive erzeugen, evaluieren und danach handeln muß. Je mehr Minibots in die Krabbelstube kommen, desto mehr läßt die Leistungsfähigkeit des Minders nach.

Die Architektur von MINDER1 entspricht den oben dargelegten Grundprinzipien. Sie besteht aus drei Subsystemen, die wiederum über eine Reihe weiterer Subsysteme verfügen.

9.4.1. Das reaktive Subsystem

Das reaktive Subsystem umfaßt vier Module: Wahrnehmung (perception), Überzeugungsmanagement (belief maintenance), reaktive Planausführung (reactive plan execution) und prä-attentive Motiverzeugung (preattentive motive generation).

Das Wahrnehmungs-Subsystem besteht aus einer Datenbank, die nur teilweise Informationen über die Umgebung des Minder enthält. Das System funktioniert innerhalb eines gewissen Radius um den Minder herum, kann aber zum Beispiel verborgene Objekte nicht endecken. Ein Update der Datenbank sieht wie folgt aus:

[new_sense_datum

time 64 name minibot4 type minibot status alive distance 5.2 x 7.43782 y 12.4632 id 4 charge 73 held false]

Im Klartext bedeutet das: Information zum Zeitpunkt 64 über den Minibot mit dem Namen minibot4: Er lebt, hält sich in einer Entfernung von 5.2 Einheiten vom Minder auf, hat die ID 4 und die Ladung 73 und wird nicht von einem anderen Agenten gehalten.

Das Überzeugungsmanagement-Subsystem bezieht seine Informationen zum einen aus den Informationen des Wahrnehmungs-Subsystems, zum anderen aus einer Überzeugungs-Datenbank, in der zum Beispiel festgehalten wird, daß Zäune Gegenstände sind, mit denen man einen Graben absichern kann. Um falsche Überzeugungen aus dem System löschen zu können, ist jeder Überzeugung ein Defeater zugeordnet. Wenn der Defeater als wahr evaluiert wird, dann wird die zugehörige Überzeugung aus der entsprechenden Datenbank gelöscht. Ein Beispiel:

[belief time 20 name minibot8 type minibot status alive distance 17.2196

x 82.2426 y 61.2426 id 8 charge 88 held false

[defeater

[[belief == name minibot8 == x ?Xb y ?Yb ==]

[WHERE distance(myself.location, Xb,Yb) < sensor_range]

[NOT new_sense_datum == name minibot8 ==]]]]

Der Defeater bedeutet in diesem Fall: "WENN ich eine Überzeugung bezüglich minibot8 besitze UND ich habe keine neuen Wahrnehmungsdaten über minibot8 UND ich befinde mich an einer Position, in der ich meiner Überzeugung nach neue Wahrnehmungsdaten über minibot8 haben sollte DANN ist meine Überzeugung falsch."

Das Subsystem der reaktiven Planausführung ist notwendig, damit der Minder schnell auf wechselnde äußere Umstände reagieren kann. Wenn er zum Beispiel den Plan hat, sich von einer Position der Krabbelstube zur anderen zu bewegen, dann soll dieser Plan ausgeführt werden, ohne zu viele Ressourcen zu beanspruchen. Dazu verwendet MINDER1 eine Methode, die von Nilsson (1994) entwickelt wurde und sich teleo-reactive (TR) program formalism nennt. MINDER1 verfügt über dreizehn solcher TR-Programme, die es dem Minder zum Beispiel ermöglichen, nach Objekten zu suchen, im Raum zu manövrieren oder bestimmte Ziele anzusteuern.

Um TR-Programme einsetzen zu können, benötigt der Minder zunächst einmal Ziele. Diese werden vom Subsystem der prä-attentiven Motiverzeugung produziert, das aus einer Reihe von Generaktivatoren(generactivators) besteht. Ein Beispiel ist der Generaktivator G_low_charge, der die Überzeugungsdatenbank nach Informationen über Babys mit niedriger Ladung durchforstet. Findet er eine solche Information, bildet er daraus ein Motiv und deponiert es in der Motiv-Datenbank. Ein Beispiel:

[MOTIVE motive [recharge minibot4] insistence 0.322 status sub]

Der Status sub bedeutet dabei, daß das Motiv den Filter noch nicht überwunden hat.

MINDER1 verfügt über acht Generaktivatoren, die unterschiedliche Anliegen (concerns) ausdrücken.

9.4.2. Das deliberative Subsystem

Das deliberative Subsystem von MINDER1 besteht aus den Modulen Filter, Motivmanagement und Planausführung. Alle diese Module sind flach (shallow), besitzen also wenig Detailtiefe.

Die Filterschwelle in MINDER1 ist eine reale Zahl zwischen 0 und 1. Ein Motivator mit dem Status sub kann sie überwinden, wenn sein Insistenzwert höher ist als der Wert der Filterschwelle. Der Status des Motivators verändert sich dann von sub zu surfacing. Ein Motivator, dem es während eines Zeitzyklus nicht gelingt, den Filter zu überwinden, kann vom Generaktivator mit einem neu berechneten Insistenzwert ein weiteres Mal ins Rennen geschickt werden.

Alle Motivatoren, die den Filter überwunden haben, werden vom Motivmanagement verarbeitet und erhalten den Status surfaced. Das Motivmanagement arbeitet mit den drei Modulen Entscheidung (deciding), Disposition (scheduling) und Expansion (expanding).

Das Modul "Disposition" legt fest, ob der Motivator sofort oder erst später bearbeitet werden soll. Wird er direkt weiterverarbeitet, erhält er den Status active; wird er später verarbeitet, erhält er den Status suspended.

Eine solche Entscheidung ist meistens erst dann möglich, wenn der Motivator einer näheren Prüfung unterzogen worden ist. Dies geschieht durch das Modul "Expansion". Der Motivator wird so expandiert, daß er einen Metaplan enthält. Ein Beispiel:

[MOTIVE motive [save ditch1 minibot5] insistence 0.646361 status active]

wird teilweise expandiert zu:

[MOTIVE motive [save ditch1 minibot5] insistence 0.646361 status active

plan [[decide] [get_plan]]

trp [stop]

importance undef]

Die Planschritte decide und get_plan des Metaplans sind Aufrufe von Management-Prozessen.

Aus dem Modul "Expansion" kann der Motivator direkt ausgeführt werden (Status: executed), kann ein gespeicherter Plan abgerufen werden (Status: active, meta) oder der Motivator an das Modul "Entscheidung" weitergereicht werden (Status: active, meta).

Der aktive Motivator wird im Modul "Entscheidung" einer Routine unterzogen, die seine Wichtigkeit festlegt. Diese Wichtigkeit wird heuristisch aus dem Insistenzwert ermittelt; die Ermittlung der Dringlichkeit eines Motivators ist in MINDER1 noch nicht implementiert. Als Resultat kann er entweder zurückgewiesen (Status: suspended, meta) oder weiterbearbeitet werden (Status: active, meta).

Das Subsystem der Planausführung schließlich ist in einer Reihe von TR-Programmen implementiert, die wieder andere TR-Programme aufrufen können. MINDER1 verfügt über neun action primitives.

9.4.3. Das Meta-Management-Subsystem

MINDER1 verfügt über zwei Module im Meta-Management-Subsystem: die Veränderung des Filter-Schwellenwertes und das Entdecken perturbanter Zustände.

Das Filter-Schwellenwert-Modul beobachtet die Zahl der Motivatoren, denen es gelingt, den Filter zu überwinden. Wenn es mehr als drei sind, wird der Schwellenwert heraufgesetzt, und zwar so lange, bis nur noch drei oder weniger Motivatoren in Bearbeitung sind. Dabei werden auch bereits bearbeitete Motivatoren mit dem Status suspended wieder in den Status sub versetzt, wenn ihr Insistenzwert niedriger ist als der Schwellenwert des Filters. Erst wenn weniger als drei Motivatoren in der Bearbeitung sind, wird der Schwellenwert wieder abgesenkt.

Die Interaktion dieses Moduls und der Generaktivatoren, welche die Insistenzwerte der Motivatoren erneut berechnen, führt zu einer ständigen Bewegung der Motivatoren vom prä-attentiven in den attentiven Zustand und zurück.

Das System ist in dieser Form noch nicht in der Lage, Perturbanzen zu erzeugen. Sloman spricht im Zusammenhang mit MINDER1 deshalb von "Proto-Perturbanzen". Um Proto-Perturbanzen zu erzeugen, greift Sloman zu einem Kunstgriff, der durch die mangelnde Komplexität des Systems notwendig wird. Motivatoren, die sich auf beschädigte Minibots (Babys) beziehen, erhalten per definitionem einen hohen Insistenzwert; die Management-Prozesse allerdings teilen diesen Motivatoren einen niedrigen Wichtigkeitsgrad zu - also eine Abweichung vom üblichen Verhalten der Management-Prozesse, in denen die Wichtigkeit analog der Insistenz bewertet wird.

Das entsprechende Modul im Meta-Management-Subsystem wurde so konstruiert, das es die Zurückweisungrate (rate of rejection) von Motivatoren mißt. Wenn dieser Wert eine bestimmte Schwelle überschreitet, dann ist ein proto-perturbanter Zustand eingetreten.

Tatsächlich treten bei MINDER1 entsprechende Proto-Perturbanzen auf. Allerdings kann das Subsystem mit dieser Information nichts weiter anfangen; dafür ist das gesamte System noch zu wenig ausgereift.

9.5. Zusammenfassung und Bewertung

Slomans theoretischer Ansatz ist mit Sicherheit einer der interessantesten bei der Entwicklung emotionaler Computer. Dabei ist es weniger sein spezifisches Interesse an Emotionen, sondern eher seine Betonung der Architektur, die neue Perspektiven eröffnet.

Sloman führt theoretisch am konsequentesten durch, was andere ebenfalls angedacht haben: daß es keinen fundamentalen Unterschied zwischen Emotion und Kognition gibt. Beides sind Aspekte von Kontrollstrukturen eines autonomen Systems.

Eine detaillierte Betrachtung von Slomans Arbeiten von 1981 bis 1998 fördert jedoch eine Reihe von Unklarheiten zutage. So ist die Abgrenzung der Begriffe Ziel (goal), Motiv (motive) und Motivator (motivator) gegeneinander undeutlich, weil sie von ihm willkürlich und im steten Wechsel verwendet werden.

Auch wird nicht klar, welche Funktion Perturbanzen bei der Entstehung von Emotionen genau haben und wie sie mit dem von ihm postulierten globalen Alarmsystem zusammenhängen. Dabei ist interessant, daß in den frühen Arbeiten von diesem Alarmsystem noch keine Rede war, sondern vorwiegend von Perturbanzen; in den aktuellen Arbeiten hat sich dieses Verhältnis umgekehrt.

Der Beweis, den Sloman mit MINDER1 antreten wollte, kann in der derzeitigen Form nicht überzeugen. Weder entstehen Perturbanzen aus dem Zusammenspiel der Elemente des Systems (die Programmierer mußten mächtig nachhelfen, um Proto-Perturbanzen zu erzeugen), noch lassen sich daraus weitergehende Rückschlüsse auf die Emotionen bei Menschen ziehen.

Dennoch ist es gerade die theoretische Tiefe und Breite von Slomans Arbeiten, die dem Studium der Emotionen neue Impulse verleihen kann. Seine Verbindung von designorientiertem Ansatz, Evolutionstheorie und Diskussion über virtuelle und physische Maschinen ist tiefgehender als alle anderen Ansätze zur Konstruktion autonomer Agenten.